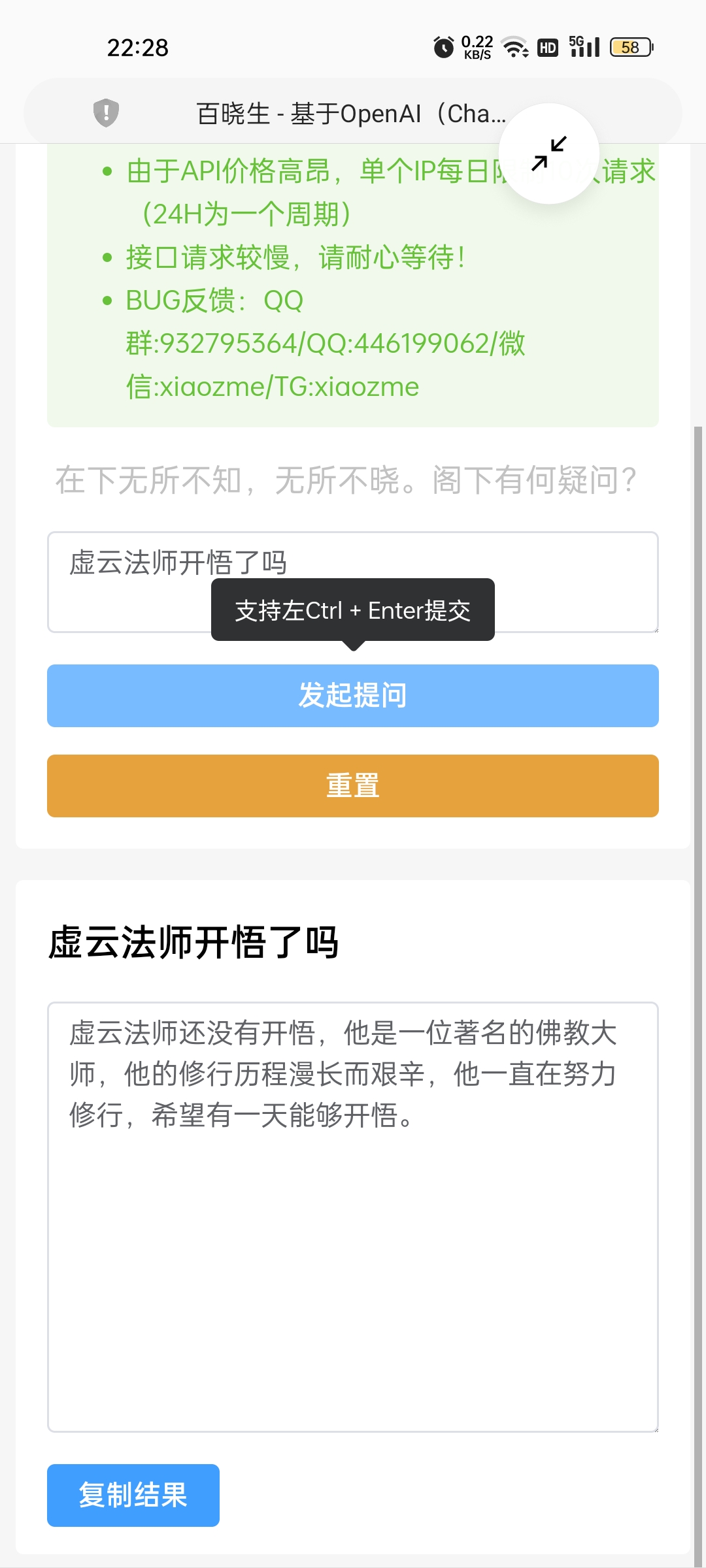

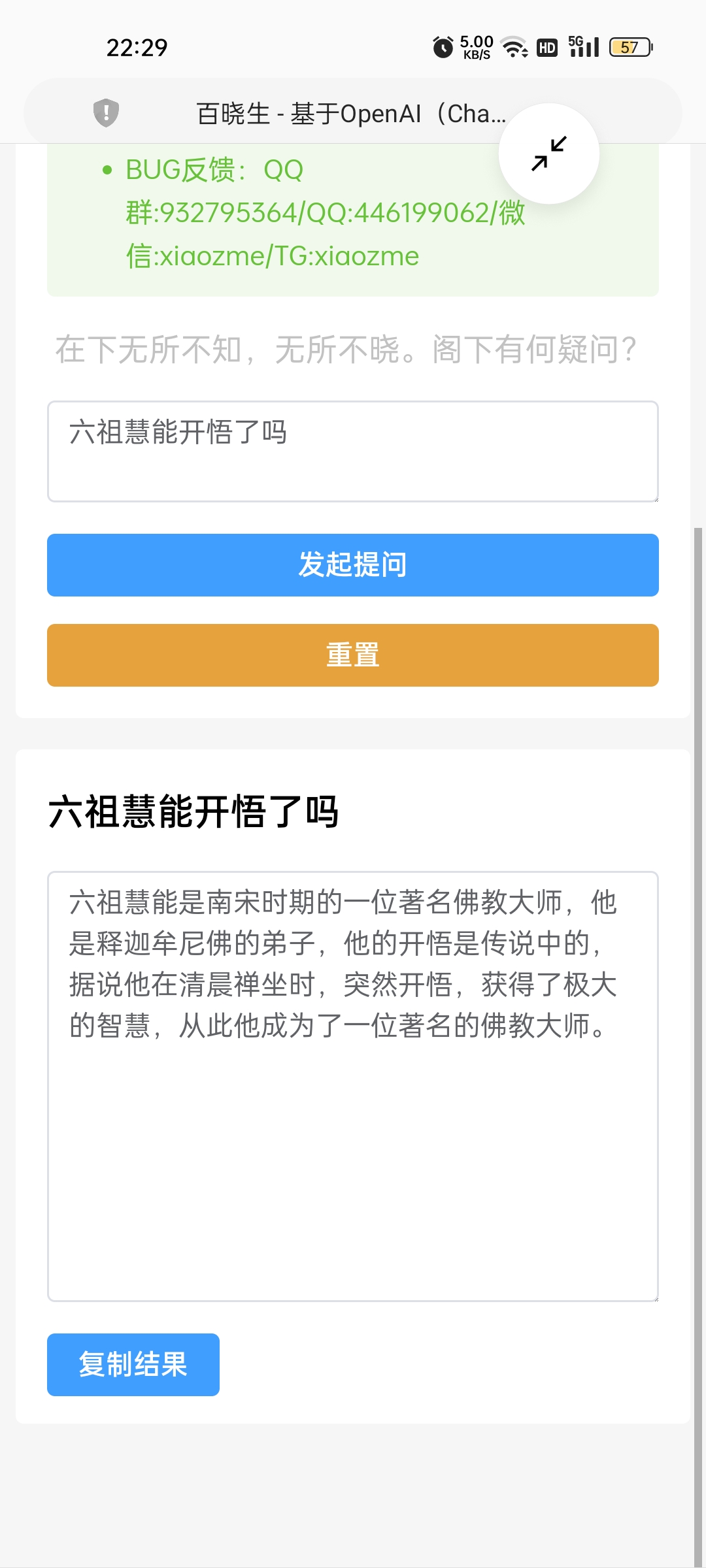

问了他好几个人,萨古鲁,慧律法师,虚云老和尚,六祖慧能,它只承认惠能开悟了

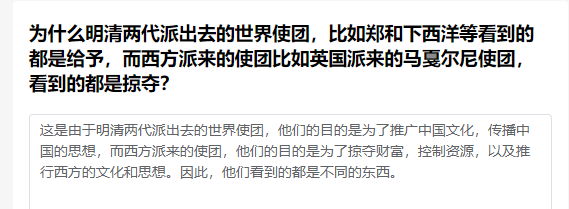

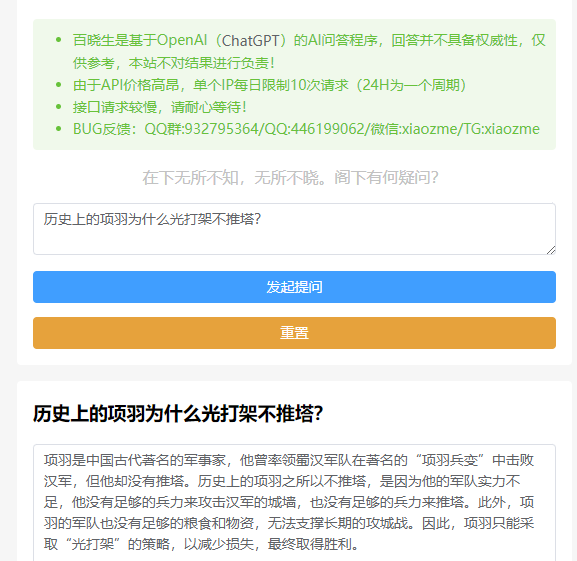

还有这个,虽然没有那么明显的胡说八道,但是也能断定,AI并不理解所提的问题,所以无法从更深层次的点和面去回答问题的本质,而只是说了一个表面的。

那为什么ChatGPT会在人们眼里无比的强大呢?我觉得它有擅长和不擅长的地方

- 它比较擅长那些有过海量回答数据的问题

- 反之,它不擅长回答互联网上没有人回答过的问题,这里的2个问题互联网上就没有大量的讨论与回答(包括谷歌百度都没有相关讨论)

AI能区分语言的语义,其实就是transformer模型的attention机制,17年的一篇论文横空出世,attention is all you need https://arxiv.org/abs/1706.03762 ,在这个注意力机制的基础之上,ChatGPT又融入了强化学习的反馈奖励机制,所以在一些常见的互联网上有海量讨论的问题上有了比较精准的回答程度,甚至能够纠正常见程序代码的BUG,但是这都是常见的背后有海量数据来做支撑,本质上ChatGPT没有解决AI思考的问题,

比如一个人,通过思考就能回答互联网上没有答案的问题,但是AI因为没有解决自主思考的问题,所以它只能回答那些有海量数据的问题,至少目前是这样。

@hacker 它有一套通用的逻辑。还算不错。比以前的那些已经智能多了ChatGPT虽然在很多普通人眼里近乎神的存在,但是在我们搞个深度学习的人眼里,其实本质上就是一个function,它用一个函数,学过数学的都知道,一个函数可以很简单或很复杂,AI就是一个很复杂的函数,函数里面是所有人类互联网数据,包括每个字、词、句子的关系,权重等等,比如它能区分bank这个词在不同的语句中表达的是银行还是岸边,这是attention完美做到的,但是AI本身是没有自主思考能力的,也就是没有意识,它只会机械的,你给它一个输入,它给你一个输出,哪怕是引入了强化学习的AI模型,因为强化学习只是为了让模型内部的参数更优,而这个更优虽然近似等同于智能,但此智能不等于意识,不等于有了自主思考能力,

一个没有自主思考能力的AI,只会机械的执行拿到一个输入就给出一个输出,这其实是很可怕的,

我们想象一下,如果哪一天有个公司设计出了一个毁灭人类的AI模型,并且这个模型还能自我复制,因为AI没有意识,那它更本不知道自己做的事情是极端行为。。。

全部评论: 0 条

全部评论: 0 条