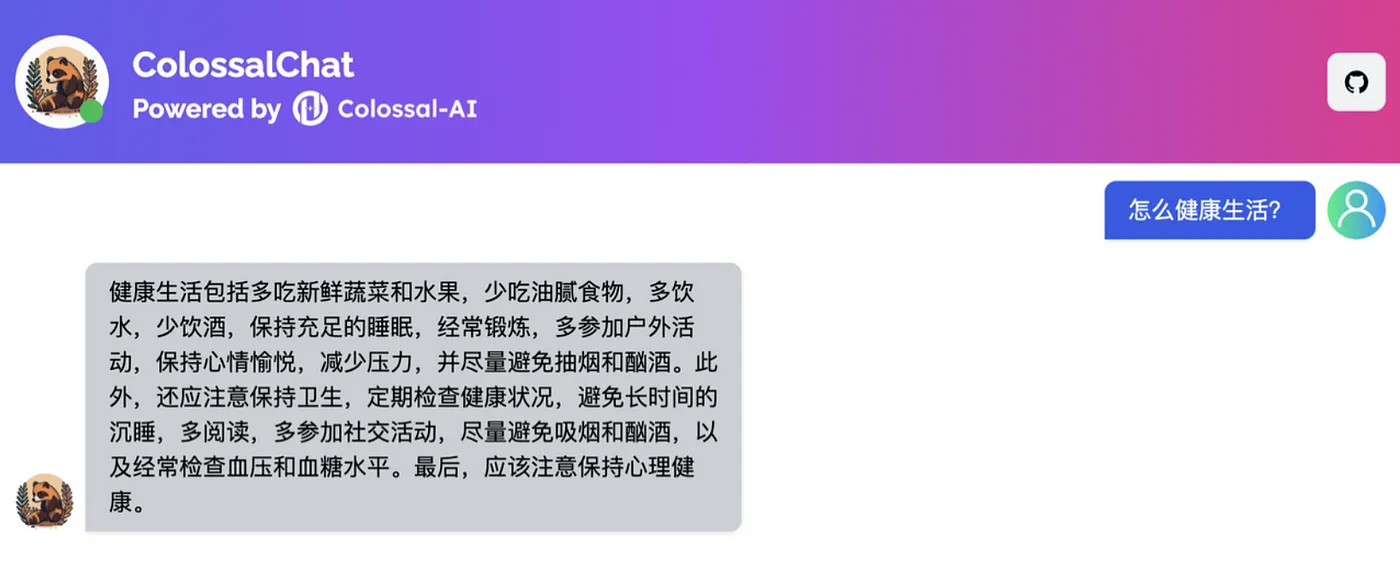

ColossalChat 体验地址:https://chat.colossalai.org/

https://github.com/hpcaitech/ColossalAI/tree/main/applications/Chat

虽然 GPT 系列中的模型,例如 ChatGPT 和 GPT-4,非常强大,但它们不太可能完全开源。幸运的是,开源社区一直在努力解决这个问题。

例如,Meta 开源了 LLaMA 模型,它提供的参数大小从 70 亿到 650 亿不等。在大多数基准测试中,一个 130 亿参数的模型可以胜过 1750 亿个 GPT-3 模型。然而,由于它没有指令调整阶段,其实际生成的结果并不令人满意。

Stanford 的 Alpaca 通过调用 OpenAI 的 API 以自我指导的方式生成训练数据。这个轻量级模型只有 70 亿个参数,可以用一小部分成本进行微调,以实现类似于具有 1750 亿个参数的超大型语言模型(如 GPT-3.5)的会话性能。

然而,现有的开源解决方案在 RLHF(人类反馈强化学习)的第一阶段只能被视为有监督的微调模型,而不会执行后续的对齐和微调阶段。此外,Alpaca 的训练数据集仅限于英语,这在一定程度上限制了模型的性能。

然而,ChatGPT 和 GPT-4 令人印象深刻的效果是由于在训练过程中引入了 RLHF,这增加了生成内容与人类价值观的一致性。

ColossalChat基于LLaMA模型,是第一个包含完整RLHF复制ChatGPT-like模型的实用开源项目,是最接近ChatGPT原技术路线的项目!

全部评论: 0 条

全部评论: 0 条